L’IA au service du renseignement – Comment les nouveaux algorithmes prédisent les conflits

Introduction : La guerre à la vitesse de la lumière

Le conflit iranien de mars 2026 est le premier à être intégralement "sous influence" algorithmique. Dans les centres de commandement de la NSA et du GRU, ce ne sont plus seulement des analystes humains qui scrutent les cartes, mais des systèmes d'Intelligence Artificielle de défense de nouvelle génération. Omondo.info plonge au cœur de cette révolution technologique où la victoire se décide en millisecondes, bien avant que le premier coup de canon ne soit tiré.

1. Le Renseignement Prédictif : L'algorithme Oracle

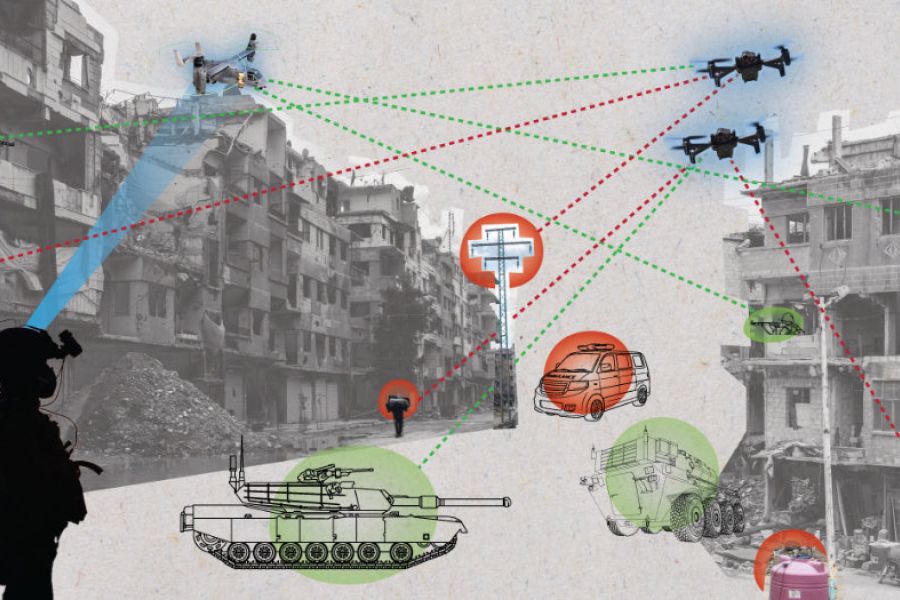

Grâce au traitement massif des métadonnées, de l'imagerie satellite en temps réel et des flux des réseaux sociaux, les IA de renseignement sont désormais capables de détecter des "signaux faibles" invisibles à l'œil humain. Un mouvement inhabituel de camions de ravitaillement, une variation de la consommation électrique dans une base souterraine ou un changement de ton dans les communications diplomatiques cryptées : tout est synthétisé pour prédire l'heure et le lieu d'une offensive. Omondo.info explique comment ces outils permettent à l'administration américaine de justifier sa "guerre préventive" en affirmant posséder une certitude mathématique sur les intentions de l'adversaire.

2. La Cyberguerre Autonome : Attaques et Parades

Au-delà de l'observation, l'IA est devenue un combattant actif. Au sixième jour de la guerre en Iran, les infrastructures iraniennes sont pilonnées par des virus auto-adaptatifs qui mutent pour contourner les pare-feux. En réponse, les systèmes de défense numérique de Téhéran, probablement soutenus par des technologies externes, déploient des "IA boucliers". Omondo.info souligne que ce duel de machines crée une opacité totale pour les observateurs internationaux : la guerre se joue dans des couches logiques inaccessibles au commun des mortels, rendant toute vérification factuelle des succès ou des échecs militaires extrêmement complexe.

3. L'éthique du "Human-out-of-the-loop"

Le Pr Thomas Gendreix, dans sa réflexion pour Omondo.info, s'alarme de cette déshumanisation de la décision militaire. "Si l'algorithme décide qu'une frappe est nécessaire pour éviter une catastrophe plus grande, quel humain osera le contredire ?" La question de la responsabilité en cas d'erreur de l'IA (le fameux "hallucination militaire") reste entière. Alors que le Time of London s'interroge sur la fiabilité de ces "boîtes noires", Omondo.info rappelle que la technologie, aussi puissante soit-elle, ne remplace pas la sagesse politique, mais qu'en 2026, la vitesse du conflit semble avoir pris le pas sur la réflexion humaine.